Sự chuyển dịch này phản ánh mức độ tích hợp sâu rộng của agentic AI vào các hệ thống kinh doanh, sản xuất và dịch vụ, đồng thời đặt ra những thách thức an ninh lớn hơn nhiều so với các mô hình AI đơn nhiệm trước đây. Bài viết làm rõ xu hướng, những mối đe dọa mới và hàm ý đối với các chiến lược an ninh mạng trong bối cảnh agentic AI nổi lên như một bề mặt tấn công chủ đạo.

Giới thiệu chung

Sự phát triển nhanh chóng của trí tuệ nhân tạo đang đưa các hệ thống từ vai trò hỗ trợ ra quyết định sang mô hình hoạt động có mức độ tự chủ cao, thường được gọi là agentic AI. Không giống các mô hình AI truyền thống chỉ phản hồi theo yêu cầu cụ thể, agentic AI có khả năng tự lập kế hoạch, phân rã mục tiêu, ra quyết định theo ngữ cảnh và thực thi chuỗi hành động kéo dài với mức can thiệp tối thiểu từ con người. Những đặc tính này cho phép hệ thống thích nghi linh hoạt với môi trường động và xử lý các bài toán phức tạp mang tính liên ngành.

Trong bối cảnh hiện nay, agentic AI ngày càng được triển khai rộng rãi trong các lĩnh vực như bảo trì dự đoán trong công nghiệp, chuỗi cung ứng thông minh, tự động hóa phát triển và vận hành phần mềm, cũng như quản trị hệ thống công nghệ thông tin quy mô lớn. Các hệ thống này thường được kết nối trực tiếp với nguồn dữ liệu nội bộ, API bên thứ ba và hạ tầng vận hành cốt lõi, cho phép chúng không chỉ phân tích mà còn chủ động thực hiện hành động trên hệ thống thực.

Tuy nhiên, chính mức độ tự chủ và khả năng tương tác sâu với môi trường vận hành đã khiến agentic AI trở thành một lớp bề mặt tấn công mới trong kiến trúc an ninh mạng. Khác với các ứng dụng AI bị giới hạn trong phạm vi xử lý dữ liệu, agentic AI có thể trở thành điểm trung gian ra quyết định, nơi một hành vi sai lệch, một dữ liệu đầu vào bị thao túng hoặc một chuỗi logic bị khai thác có thể dẫn đến tác động lan truyền trên nhiều hệ thống liên kết. Do đó, trong khi agentic AI mang lại tiềm năng đáng kể về hiệu quả và tự động hóa, nó đồng thời thách thức các khái niệm an ninh mạng truyền thống, đòi hỏi những cách tiếp cận mới trong đánh giá rủi ro, kiểm soát truy cập, giám sát hành vi và quản trị vòng đời hệ thống AI.

Xu hướng và nhận thức từ thực tế

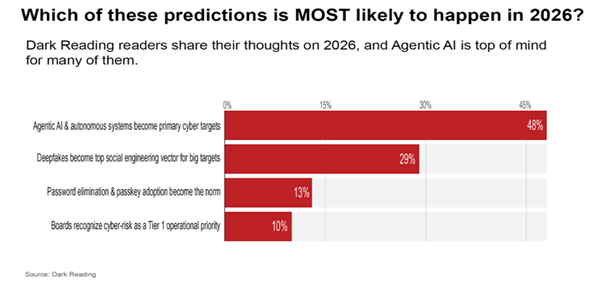

Các khảo sát gần đây trong cộng đồng an ninh mạng cho thấy nhận thức về rủi ro từ agentic AI đang gia tăng nhanh chóng. Kết quả thăm dò độc giả của Dark Reading ghi nhận 48% người tham gia dự đoán agentic AI sẽ trở thành bề mặt tấn công nổi bật vào cuối năm 2026, vượt qua nhiều mối đe dọa truyền thống như lừa đảo kỹ thuật xã hội hay rò rỉ dữ liệu thông thường. Con số này phản ánh sự dịch chuyển trong nhận thức rủi ro: thay vì tập trung vào các hình thức tấn công đã quen thuộc, cộng đồng chuyên môn đang chú ý đến những hệ thống có khả năng tự chủ, tự ra quyết định và tương tác sâu với hạ tầng vận hành.

Kết quả khảo sát theo Dark Reading

Một yếu tố then chốt khiến agentic AI trở thành mục tiêu hấp dẫn là mức độ tích hợp sâu với hạ tầng doanh nghiệp. Khác với chatbot hoặc công cụ phân tích độc lập, agentic AI thường được cấp quyền truy cập vào cơ sở dữ liệu nội bộ, hệ thống quản lý tài nguyên doanh nghiệp, công cụ DevOps và các API bên ngoài. Điều này biến chúng thành “điểm giao cắt quyền lực” trong kiến trúc số. Nếu bị thao túng, một agent có thể thực hiện chuỗi hành động hợp lệ về mặt kỹ thuật nhưng sai lệch về mặt mục tiêu, gây ra hậu quả lan rộng mà không cần khai thác lỗ hổng truyền thống.

Ngoài ra, ENISA trong các báo cáo gần đây về AI và an ninh mạng cũng lưu ý rằng rủi ro không chỉ nằm ở việc xâm nhập hệ thống, mà còn ở thao túng hành vi hệ thống. Với agentic AI, tấn công có thể chuyển từ mô hình “xâm nhập - chiếm quyền - phá hoại” sang mô hình tinh vi hơn: “ảnh hưởng - định hướng - điều khiển quyết định”. Điều này đặc biệt đáng lo ngại trong các lĩnh vực như sản xuất thông minh, tài chính tự động và hạ tầng trọng yếu, nơi các quyết định của AI có tác động trực tiếp đến quy trình vật lý hoặc tài chính.

Nguy cơ từ các hệ thống Agentic AI

Giới chuyên gia cho rằng, các hệ thống AI hành động độc lập, dù được thiết kế để hành động với mức độ tự chủ cao và ít cần sự giám sát của con người, vẫn chưa thể đạt đến logic và tư duy phức tạp như bộ não con người. Các hệ thống này tiếp tục chịu tác động từ những rủi ro nền tảng vốn đã được ghi nhận trong các mô hình trí tuệ nhân tạo trước đây, bao gồm nguy cơ rò rỉ hoặc suy diễn dữ liệu nhạy cảm, xâm phạm quyền riêng tư cá nhân, cũng như những hạn chế về tính minh bạch và khả năng giải thích quyết định của hệ thống.

Một mối lo ngại cốt lõi là quyền truy cập rộng và quyền tự động trên tài nguyên của agentic AI. Các hệ thống này thường cần quyền truy cập sâu vào dữ liệu, API nội bộ và các công cụ khác để hoàn thành nhiệm vụ. Khi quyền này bị chiếm đoạt, kẻ tấn công có thể khai thác agentic AI để thực hiện các tác vụ có hại, bao gồm truy cập trái phép, leo thang đặc quyền, và tự động thu thập dữ liệu quan trọng.

Đặc biệt, khi vận hành theo cơ chế học tăng cường, những nguy cơ này càng có thể bị khuếch đại, tạo ra nhiều hệ lụy pháp lý và đạo đức khó lường. Một AI tác nhân nếu không được kiểm soát chặt chẽ có thể phát tán thông tin sai lệch, thiên kiến hoặc nội dung giật gân nhằm tối ưu hóa tương tác trên mạng xã hội, đề xuất hoặc trực tiếp thực hiện các giao dịch thiếu minh bạch, thậm chí phi đạo đức trong lĩnh vực tài chính, hoặc vi phạm quyền sở hữu trí tuệ thông qua việc khai thác, sao chép các tài liệu có bản quyền mà không được cho phép.

Trước bối cảnh rủi ro ngày càng gia tăng, các doanh nghiệp và tổ chức phát triển AI cần chuyển từ cách tiếp cận triển khai theo hướng thử nghiệm sang mô hình quản trị dựa trên nguyên tắc trách nhiệm và kiểm soát hệ thống. Điều này đòi hỏi việc thiết lập các cấu trúc quản trị rõ ràng, bao gồm hội đồng đạo đức độc lập có chức năng giám sát chiến lược, cơ chế kiểm toán kỹ thuật và pháp lý định kỳ, cùng hệ thống quản trị vòng đời AI bao phủ từ giai đoạn thiết kế, huấn luyện đến vận hành và giám sát sau triển khai.

Các mối đe dọa khác liên quan

Bên cạnh rủi ro nổi lên từ agentic AI, các khảo sát chuyên ngành cũng cho thấy những mối đe dọa truyền thống không hề suy giảm mà đang tiến hóa theo hướng tinh vi hơn. Đáng chú ý, deepfake được đánh giá là phương thức kỹ thuật xã hội có mức độ đe dọa cao đối với các mục tiêu giá trị như lãnh đạo doanh nghiệp, cơ quan nhà nước và tổ chức tài chính. Sự cải thiện nhanh chóng về chất lượng tổng hợp hình ảnh, giọng nói và video, nhờ vào các mô hình sinh nội dung thế hệ mới, khiến việc phân biệt thật giả ngày càng khó khăn, đặc biệt trong các kịch bản giao tiếp từ xa hoặc xác thực qua phương tiện điện tử.

Khi deepfake được kết hợp với agentic AI, nguy cơ không chỉ dừng lại ở việc tạo nội dung giả mạo, mà còn có thể mở rộng thành các chiến dịch tự động hóa có khả năng thu thập thông tin mục tiêu, tạo kịch bản cá nhân hóa và triển khai tương tác đa bước mà không cần can thiệp liên tục của con người. Sự kết hợp này có thể hình thành một mô hình tấn công mới: tự động, thích nghi theo phản hồi của nạn nhân và có khả năng duy trì lâu dài.

Song song với đó, các cơ chế xác thực truyền thống, đặc biệt là mật khẩu, vẫn tiếp tục là điểm yếu cố hữu trong hạ tầng an ninh. Nhiều khảo sát cho thấy mặc dù các tổ chức nhận thức rõ rủi ro, mức độ chuyển đổi sang mô hình xác thực không mật khẩu hoặc sử dụng mã xác thực (passkey) vẫn còn hạn chế. Tỷ lệ ủng hộ thấp đối với việc thay thế hoàn toàn mật khẩu trong năm 2026 phản ánh thực tế rằng các rào cản về hạ tầng, khả năng tương thích hệ thống và thói quen người dùng vẫn đang làm chậm tiến trình chuyển đổi.

Tổng thể, bức tranh an ninh cho thấy agentic AI không tồn tại như một rủi ro độc lập, mà là một thành phần trong hệ sinh thái đe dọa đang hội tụ giữa tự động hóa, nội dung tổng hợp và các điểm yếu xác thực truyền thống. Điều này đòi hỏi cách tiếp cận phòng thủ mang tính hệ thống, thay vì xử lý từng công nghệ riêng lẻ.

Chiến lược an ninh mạng trong kỷ nguyên Agentic AI

Sự nổi lên của agentic AI không chỉ bổ sung một thành phần công nghệ mới vào hạ tầng số, mà còn làm thay đổi cấu trúc bề mặt tấn công truyền thống. Các nghiên cứu và khảo sát gần đây cho thấy khi AI chuyển từ vai trò công cụ hỗ trợ sang tác nhân có khả năng tự lập kế hoạch và thực thi hành động, mô hình phòng thủ cũng cần được điều chỉnh tương ứng. Điều này đặt ra những yêu cầu chiến lược mới đối với quản trị rủi ro, kiểm soát truy cập và năng lực tổ chức.

Tái định nghĩa và đánh giá lại bề mặt tấn công: Sự gia tăng của agentic AI yêu cầu các chuyên gia an ninh phải mở rộng nhận thức về bề mặt tấn công, không chỉ dừng ở các điểm truy cập truyền thống mà còn cả các đơn vị tự hoạt động trong môi trường mạng. Việc xác định, giám sát và phân tích hoạt động của agentic AI là điều kiện tiên quyết để phát hiện và ngăn chặn các hành vi bất thường trước khi chúng gây ra tác hại đáng kể.

Kiểm soát truy cập theo nguyên lý Zero Trust và xác thực liên tục: Các chiến lược phòng thủ hiện đại cần chuyển sang mô hình kiểm soát truy cập chi tiết và xác thực liên tục đối với mọi yêu cầu do agentic AI tạo ra. Điều này đặc biệt quan trọng khi các hệ thống này được cấp quyền truy cập tới dữ liệu nhạy cảm hoặc tài nguyên quan trọng như hệ thống tài chính, DevOps hoặc cơ sở dữ liệu nội bộ. Quyền truy cập phải được phân tách theo nguyên tắc tối thiểu (least privilege), kèm theo cơ chế giới hạn phạm vi hành động và kiểm tra ngữ cảnh liên tục. Cách tiếp cận này giúp giảm thiểu nguy cơ khi agentic AI bị thao túng hoặc cấu hình sai.

Quản trị tổ chức và kiểm soát “shadow AI”: Một thách thức đáng chú ý là việc triển khai agentic AI thường diễn ra phân tán trong nhiều bộ phận, vượt ra ngoài tầm giám sát trực tiếp của đội ngũ an ninh. Xu hướng sử dụng công cụ AI không chính thức (“shadow AI”) có thể dẫn đến việc tích hợp API hoặc dữ liệu nội bộ mà không qua đánh giá rủi ro đầy đủ. Điều này làm gia tăng nguy cơ rò rỉ thông tin và mở rộng bề mặt tấn công ngoài dự kiến. Do đó, bên cạnh biện pháp kỹ thuật, các tổ chức cần xây dựng chương trình đào tạo và nâng cao nhận thức về an ninh AI cho toàn bộ nhân sự. Việc ban hành chính sách rõ ràng về sử dụng AI, quy trình phê duyệt tích hợp và cơ chế báo cáo rủi ro là yếu tố then chốt để đảm bảo rằng đổi mới công nghệ không vượt khỏi khả năng kiểm soát an ninh.

Năm 2026 được dự báo là thời điểm agentic AI trở thành bề mặt tấn công chính đối với các mối đe dọa an ninh mạng, theo khảo sát ý kiến chuyên gia và độc giả Dark Reading. Sự tự chủ và quyền truy cập sâu vào hệ thống của các agentic AI mở ra nhiều điểm yếu mới, yêu cầu các chiến lược phòng thủ hiện đại hơn, bao gồm kiểm soát truy cập liên tục, nhận dạng rủi ro chuyên biệt và đào tạo nâng cao nhận thức người dùng. Tương lai của an ninh mạng sẽ phụ thuộc nhiều vào việc thích ứng với những thay đổi này và phát triển các cơ chế bảo vệ phù hợp trước agentic AI.